E drago mi je da sam video neki post ovde :).

Dakle, iako nemam nekog iskustva, ovo što sam zamislio se kreće u dobrom pravcu?

To sa find sam već negde video. Odnosno imamo problem sa nekim session folderom i logovima koji se pakuju unutra.

Kako sam ukapirao, svaka poseta, svako ko poseti sajt taj "Magento" cuva logove u tom folderu. Rekao mi da se jednom desilo da se skupio ceo terabajt O.o. Sada trenutno ima oko 15GB.

Kaze da mu je frka to sada da obrise, jer je prosli put "ubio" server kad ih je brisao (taj terabajt).

Brisao je sa ovom komandom

Code:

find session/ -name ‘sess_*’ | xargs rm

Izguglao sam da je za ovaj problem bolje uraditi rsync sa nekim praznim folderom, nesto poput ovog

Code:

# rsync -a --delete empty_dir/ yourdirectory/

a po nekim testovima je valjda još brža komanda bila

Code:

# time perl -e 'for(<*>){((stat)[9]<(unlink))}'

na ovom serveru sa kojim mogu da se igram ću da isprobam obe, mada mi se više sviđa ova rsync komanda.

Kad ispraznim te problematicne foldere, onda bas planiram Panto to sto si pomenuo.

Nasao sam ovu komandu

Code:

# find /test -mtime +7 -exec rm {} \;

koja briše fajlove koji su modifikovani zadnji put pre 7 dana. Ili bih stavio neki duži period, pa da to ubacim u skriptu sa back-upom koju planiram da okidam svaku noć ili jutro. Ne znam samo da li mu treba vise od 7 dana da cuva te logove, cemu mu uopste sluze. Ne verujem da je imao nekad potrebu da ih gleda.

Citat:

ŽIKI:

Backup baze radiš sa dump. Preporučujem da je onda zapakuješ(tar), zatim enkriptuješ(gpg) i tek onda prebaciš na dugi server(rsync).

To koliko često ćeš da radiš backup zavisi od potreba, a pošto kažeš da nikad nije rađen... :)

Zavisi i koliko su veliki sajtovi, koliko imaš mesta na disku za backup-e da čuvaš, koliko su ti važni podaci koje možeš da izgubiš...

A prva vežba na backup serveru nek ti bude vraćanje sajta iz backup-a :D Tako znaš da ako se i desi nešto, da možeš brzo da povratiš sajtove.

"Dampovao" sam danas neku bazu sa ovog servera sa kojim se igram, ali sam to rucno odradio preko Plesk-a. Siguran sam da postoji i neka skripta, mislim da sam je izguglao negde.

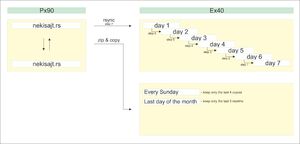

S obzirom da ima neki shop sajt sa oko 3000 artikala, velikom bazom podataka, ne znam koliko bi tu trajalo taj dump ako bih ga radio svaki dan. Da li bih sa tim ubijao server? U pitanju je px90, vidim da ima 64GB DDR4 memorije i neki odlican procesor. Taj sajt je prilicno ozbiljan, i donosi ozbiljnu lovu mesecno, pa mislim da bih morao da se potrudim da radim backup jednom dnevno. Jbg, ipak ne može to baš na sreću kao do sada... U principu, prostor je 2x2 terabajta. Mislim da je itekako dovoljno da imam po kopiju sajta jednom u zadnja 3 meseca, po jednom nedeljno u zadnjih 28 dana, i zadnja nedelja svakodnevno. to je recimo 13 kopija. Hosting je zakupljen zbog tog sajta, ali ima prostora pa je prišlepano još par desetina manje bitnih sajtova koji nemaju ni približnu posećenost.

I dobra ideja za prvu vezbu!

Pitanje jedno naivno :),

ako recimo sa resync imam dva ista foldera na dva razlicita servera, i live server mi iz nekog razloga padne, kakva je procedura za vracanje servera?

U glavi mi otprilike stoji, da domen nekako preusmerim samo na lokaciju gde mi je backup server? Pretpostavljam da preko te neke firme gde sam zakupio domen, mogu samo da redirektujem domen na taj server? Doduse, to cu u ponedeljak pitati ovog lika, kako to ide :). Pretpostavljam da ako postoji mogucnost da se redirektuje sajt, da je bolje to uraditi pa naci i resiti problem na live serveru, nego kopirati brzo nazad podatke na taj server...

backup host servera

backup host servera